This article was translated from English using AI

Hvorfor AI-strategi i sidste ende er et ledelsesproblem

Før generativ AI blev mainstream, ledede jeg transformationer på tværs af flere forsikringsselskaber, hvor automatisering af skadeprocessen var et centralt element. Det, der hurtigt stod klart, var ikke en teknologisk begrænsning, men en ledelsesmæssig realitet: fuldautomatisk beslutningstagning var hverken realistisk eller ønskelig.

Manuelle kontroller var ikke et teknologisk kompromis. De var et bevidst ledelsesvalg. Vi spurgte ikke: “Kan vi automatisere det her?” Vi spurgte: “Hvor skaber automatisering værdi? Og hvor introducerer det uacceptabel risiko?”

De spørgsmål er kun blevet vigtigere i takt med generativ AI.

Når teknisk kapacitet overhaler forretningsmæssig dømmekraft

En udbredt misforståelse i AI-adoption er, at teknisk mulighed automatisk betyder strategisk klogskab. Det gør det ikke. En effektiv AI-strategi er aldrig rent teknisk. Den befinder sig i krydsfeltet mellem økonomi, organisationsdesign, risiko og menneskelig dømmekraft.

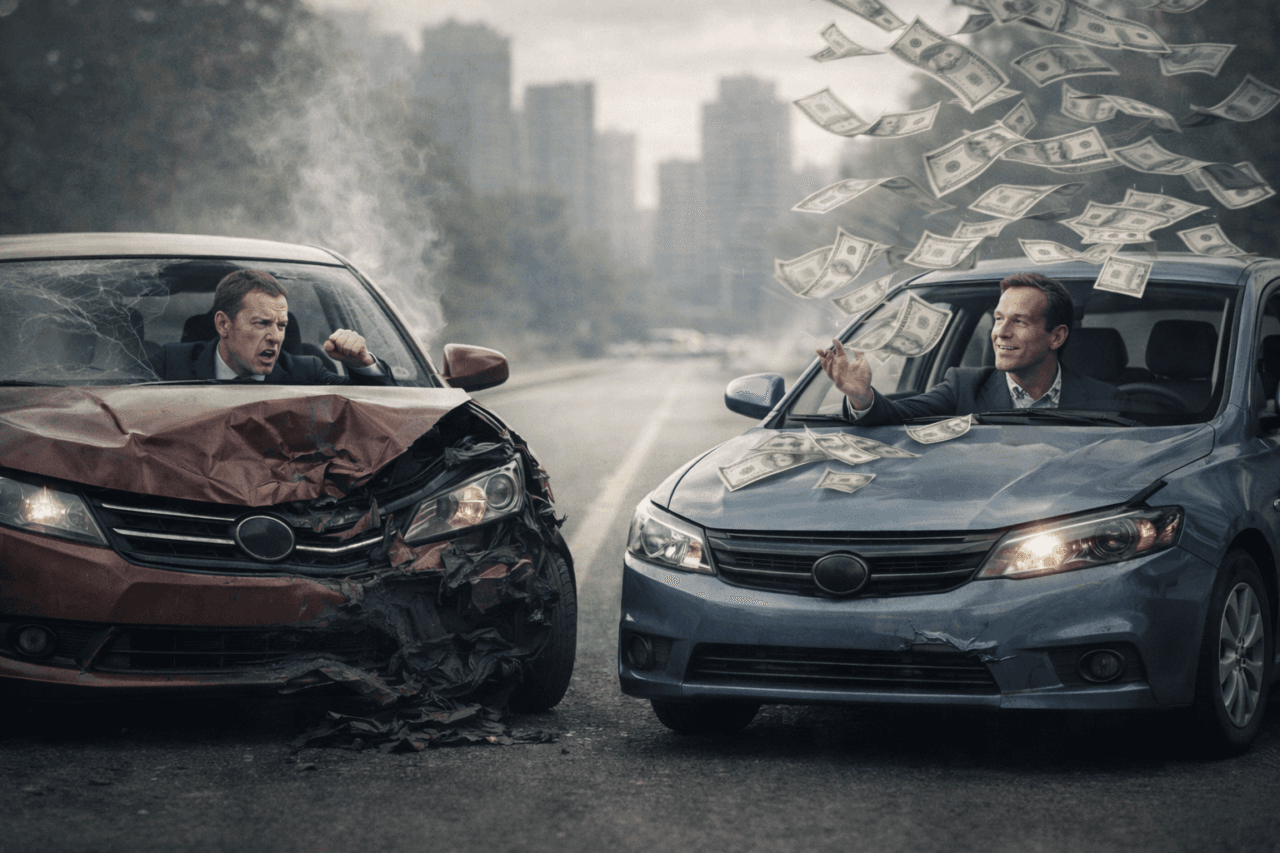

Et velkendt eksempel fra motorforsikring illustrerer spændingen. Et selskab undersøgte fuldautomatisk skadesbehandling via billedgenkendelse: kunder uploadede billeder, AI vurderede skaden, og erstatningen blev beregnet automatisk.

Teknisk fungerede systemet godt. Forretningsmæssigt gjorde det ikke.

I skadesbehandling er fejl dyre i begge retninger. Overbetalinger udhuler marginerne stille og roligt. Underbetalinger fører til tvister, eksterne vurderinger og ofte højere samlede omkostninger. Selv en lav fejlrate viste sig økonomisk uacceptabel. Systemets præcision var høj, men ikke høj nok til den beslutning, det skulle træffe.

Løsningen var ikke bedre modeller, men bedre ledelsesdesign: delvis automatisering. AI understøttede processen ved at forudfylde vurderinger, mens mennesker beholdt det endelige ansvar. Behandlingstiden faldt markant, produktiviteten steg, og de samlede omkostninger blev reduceret.

Læringen handlede ikke om AI’s kapabilitet. Den handlede om beslutningsarkitektur.

Hvorfor AI ikke kan ledes som traditionel IT

En klassisk ledelsesfejl er at behandle AI-implementering som et traditionelt IT-projekt.

Traditionelle IT-systemer opfører sig forudsigeligt inden for definerede rammer. Det gør AI-systemer ikke. De er probabilistiske, uperfekte selv inden for deres kerneområde og forringes gradvist uden for det. Det skaber en lang hale af plausible, men upålidelige output, som kræver aktiv håndtering.

Det er derfor plan-tunge, vandfaldsbaserede tilgange har svært ved at fungere. Som Clay Shirky berømt formulerede det, svarer waterfall i praksis til et løfte om ikke at lære, mens arbejdet udføres. Med generativ AI er læring selve arbejdet.

Organisationer, der lykkes, gør noget andet:

- De designer til læring, ikke perfektion AI’s skalering betyder, at de sidste procentpoint i præcision er uforholdsmæssigt dyre. Ledere skal vurdere, hvor “godt nok + menneskelig dømmekraft” skaber mere værdi end teknisk optimering.

- De vælger delvis automatisering i højrisikoområder I områder som forsikring, finans og sundhed kan ansvar ikke delegeres til en model. Hybride løsninger slår fuld automatisering både økonomisk og omdømmemæssigt.

- De arbejder agilt med implementering I stedet for store AI-strategier starter de med minimale, levedygtige planer: identificerer hvor AI realistisk kan accelerere arbejdet, gennemfører fokuserede eksperimenter, monitorerer tæt og itererer løbende.

- De bygger feedback og korrektion ind i systemet Monitorering, transparens og klare eskalationsveje er ikke tilvalg. De er centrale elementer i ansvarlig brug af AI.

Ledelsesperspektivet

AI fejler ofte, når ledere forveksler teknisk kapacitet med organisatorisk parathed.

De organisationer, der lykkes med AI, vil ikke være dem, der automatiserer mest – eller dem, der venter på sikkerhed. Det vil være dem, der lærer hurtigst. Organisatorisk. Økonomisk. Etisk.

AI-strategi er derfor i sidste ende et ledelsesproblem.

Billede: Passende nok genereret af AI.